Reglamento de IA y sector financiero: tiempo de implementación y de promover el "efecto Bruselas"

Junio de 2024

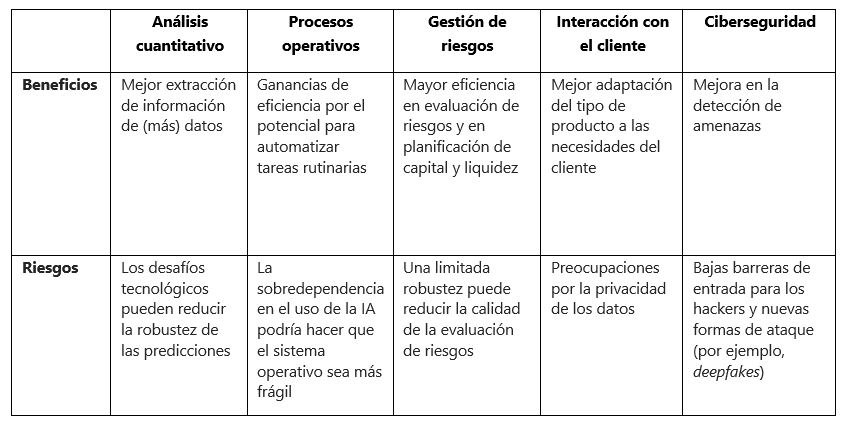

Las nuevas tecnologÃas en general y la IA en particular albergan un gran potencial transformador de los modelos de prácticamente todos los negocios. Y el sector financiero es, sin duda, uno de ellos, pudiendo apoyarse en la IA para mejorar las capacidades de análisis y predicción, automatizar procesos, mejorar la gestión de riesgos y la atención al cliente, detectar operaciones fraudulentas e incluso facilitar el cumplimiento normativo. Pero la IA no solo presenta ventajas, sino que puede llegar a amplificar riesgos existentes o incluso a crear algunos nuevos, como se recoge en la Tabla 1.

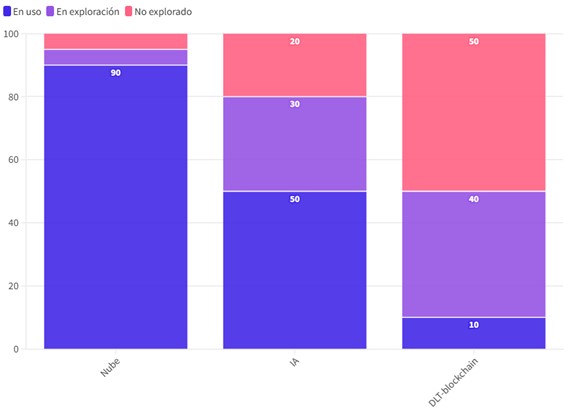

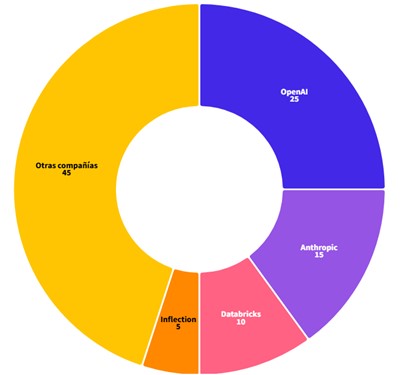

Más allá de los beneficios y riesgos que la IA puede generar para entidades individuales, la IA también puede dar lugar a riesgos en términos de estabilidad financiera. Para ello, es necesario tener en cuenta tanto la penetración tecnológica como la concentración de los proveedores de sistemas de IA. En particular, la elevada penetración que ya tiene la IA en el sector bancario (Figura 1) sumada a la concentración de los proveedores de modelos fundacionales (Figura 2) incrementa la probabilidad de que las decisiones de IA de las entidades financieras se vean afectadas por los mismos sesgos y desafÃos tecnológicos. Estos elementos requerirán aumentar la vigilancia de los supervisores macro, microprudenciales y de conducta.

Teniendo en cuenta los beneficios y los riesgos de la IA, con la aprobación del Reglamento de IA, la Unión Europea ha vuelto a ponerse a la vanguardia a nivel global en una de las actividades en las que más brilla, la regulación. El Reglamento de IA sigue un enfoque basado en riesgos, clasificando los sistemas de IA en cuatro categorÃas diferentes: (1) riesgo inaceptable (por ejemplo, sistemas de puntuación social), (2) alto riesgo (por ejemplo, sistemas empleados en infraestructuras crÃticas), (3) riesgo limitado (por ejemplo, chatbots) y (4) riesgo mÃnimo o nulo (por ejemplo, filtros de spam).

De todos los sistemas de alto riesgo identificados en el Reglamento, tres son los que más pueden llegar a afectar al sector financiero: (1) sistemas empleados para las evaluaciones de solvencia crediticia en actividad bancaria y de riesgos y establecimiento de precios en seguros de vida y salud, (2) sistemas para la monitorización y evaluación del rendimiento laboral y (3) sistemas para la contratación de personal. Los proveedores de los sistemas de alto riesgo deberán cumplir con requisitos estrictos en torno a la gestión de riesgos, la calidad de los datos, la documentación técnica, la supervisión humana, la transparencia, la solidez, la precisión y la ciberseguridad. Y las entidades que empleen esos sistemas de IA deberán hacerlo según las instrucciones detalladas por el proveedor. Además, las entidades dedicadas a la calificación crediticia o a seguros de vida y salud están obligadas a realizar una evaluación del impacto en los derechos fundamentales antes de desplegar un sistema de IA de alto riesgo.

Aunque el Reglamento de IA lista las obligaciones a cumplir por proveedores y usuarios de sistemas de IA de alto riesgo, es necesario mayor detalle en los actos delegados y de ejecución que deberán adoptarse en los próximos meses y años. A la todavÃa indefinición de muchos elementos pendientes de desarrollar se une el hecho de que aún no está claro qué será clasificado como IA exactamente. ![]() Por ejemplo, en las evaluaciones de solvencia crediticia, se emplean con mucha frecuencia modelos de regresión logÃstica y aún no está claro si estos modelos se considerarán IA o no. En caso de serlo, podrÃa alterarse el modelo operativo de las agencias de evaluación crediticia, que ante la perspectiva de tener una fuerte carga de cumplimiento por el empleo de este tipo de modelos econométricos, podrÃan decidir incrementar el uso de sistemas propiamente de IA. Pero en estos momentos, la situación es de indefinición.

Por ejemplo, en las evaluaciones de solvencia crediticia, se emplean con mucha frecuencia modelos de regresión logÃstica y aún no está claro si estos modelos se considerarán IA o no. En caso de serlo, podrÃa alterarse el modelo operativo de las agencias de evaluación crediticia, que ante la perspectiva de tener una fuerte carga de cumplimiento por el empleo de este tipo de modelos econométricos, podrÃan decidir incrementar el uso de sistemas propiamente de IA. Pero en estos momentos, la situación es de indefinición.

A lo anterior se suma que la IA no solo está regulada en el Reglamento de IA, siendo necesario que el sector tenga en cuenta también la normativa general de protección de datos (GDPR), el Reglamento de Gobernanza de Datos, la regulación de ciberseguridad tanto general (NIS2) como especÃfica para el sector financiero (DORA), asà como otra normativa que está en negociación (por ejemplo, el Reglamento FiDA, que prevé la introducción del Open Finance).

Asimismo, se introduce una gobernanza tanto en torno a nuevas instituciones como la Oficina UE de IA, que deberá controlar la implementación efectiva de los proveedores de IA generativa de propósito general (GPIA) y adoptar los códigos de buenas prácticas y la Junta Europea de IA, con representación de los Estados miembros y análoga a la Junta Europea de Protección de Datos, como en torno a instituciones tradicionales como la Comisión Europea y la Agencia Europea de Protección de Datos.

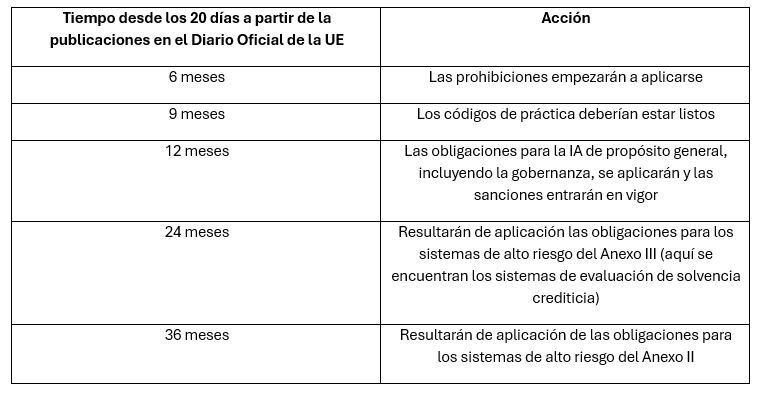

Afortunadamente, la entrada en vigor de las distintas obligaciones del Reglamento de IA es escalonada, en lÃnea con lo recogido en la Tabla 2.

Regular la IA ha sido un movimiento acertado por parte de la UE: para que empresas, administraciones y ciudadanos puedan extraer el máximo partido de esta nueva tecnologÃa, es esencial que confÃen en ella, para lo cual han de sentirse protegidos de los principales riesgos. Pero en un mundo cada vez más globalizado, contar con un marco regulatorio exclusivo para la UE no es suficiente. Y eso que la aproximación del Reglamento de IA es extraterritorial en el sentido de que resulta de aplicación a todos los proveedores y usuarios de sistemas de IA, estén establecidos en la UE o no, siempre que el producto generado por el sistema sea empleado en la UE. Pero a pesar de ello, es fundamental conseguir el mismo "efecto Bruselas" que se alcanzó con la GDPR, es decir, que otras jurisdicciones sigan los principios fundamentales del enfoque regulatorio de la UE. Si bien antes la UE conseguÃa beneficiarse de este "efecto Bruselas" de manera relativamente pasiva, parece que ahora será necesario un esfuerzo mucho más activo para que nuestro marco normativo se vea como el modelo a seguir.

A su vez, en esta legislatura europea que ahora dejamos atrás, la cantidad de normas aprobada ha sido extraordinaria y tanto el sector privado como las autoridades supervisoras requieren tiempo para su correcta implantación. Por ello, posibles ideas como la introducción de una normativa especÃfica de IA para el sector financiero parecen apresuradas, en la medida en que ni siquiera ha empezado a implementarse el recién aprobado Reglamento de IA. AsÃ, a mi juicio, serÃa óptimo que en la próxima legislatura europea hubiera cierta pausa regulatoria, para facilitar la implementación de la gran cantidad de normas aprobadas en este último ciclo institucional, que en algunos casos incluso se solapan entre sÃ.

Es tiempo de implementación y de promover el "efecto Bruselas".